Apache Spark 简介

Apache Spark 是专为大规模数据处理而设计的快速通用的计算引擎。Spark是UC Berkeley AMP lab (加州大学伯克利分校的AMP实验室)所开源的类Hadoop MapReduce的通用并行框架,Spark,拥有Hadoop MapReduce所具有的优点;但不同于MapReduce的是Job中间输出结果可以保存在内存中,从而不再需要读写HDFS,因此Spark能更好地适用于数据挖掘与机器学习等需要迭代的MapReduce的算法。

Spark 是一种与 Hadoop 相似的开源集群计算环境,但是两者之间还存在一些不同之处,这些有用的不同之处使 Spark 在某些工作负载方面表现得更加优越,换句话说,Spark 启用了内存分布数据集,除了能够提供交互式查询外,它还可以优化迭代工作负载。

Spark 是在 Scala 语言中实现的,它将 Scala 用作其应用程序框架。与 Hadoop 不同,Spark 和 Scala 能够紧密集成,其中的 Scala 可以像操作本地集合对象一样轻松地操作分布式数据集。

尽管创建 Spark 是为了支持分布式数据集上的迭代作业,但是实际上它是对 Hadoop 的补充,可以在 Hadoop 文件系统中并行运行。通过名为 Mesos 的第三方集群框架可以支持此行为。Spark 由加州大学伯克利分校 AMP 实验室 (Algorithms, Machines, and People Lab) 开发,可用来构建大型的、低延迟的数据分析应用程序。

准备工作

环境

1 | JDK:1.8 |

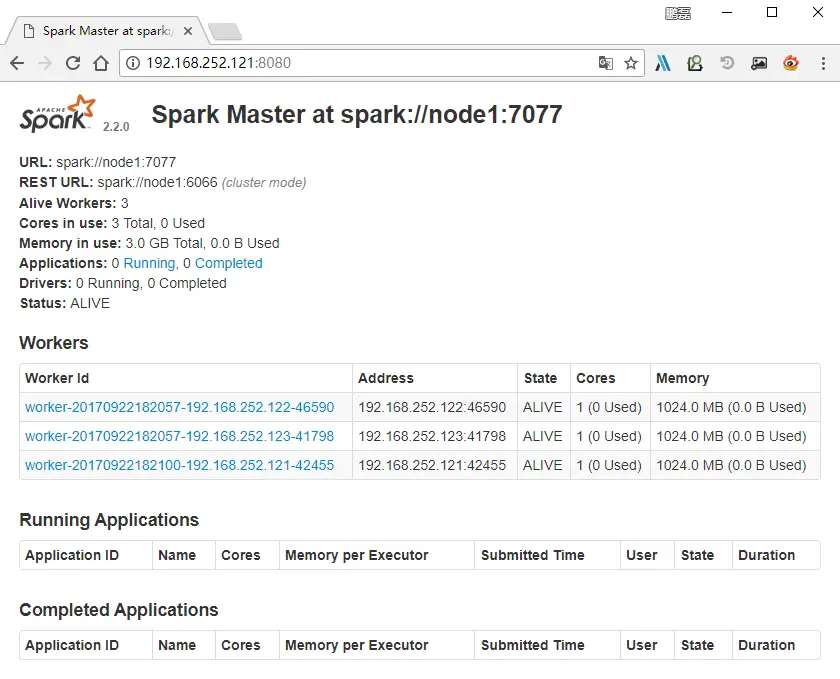

| 主机名 | ip地址 | 安装服务 |

|---|---|---|

| spark-master | 192.168.252.121 | jdk、hadoop、spark、scala |

| spark-slave01 | 192.168.252.122 | jdk、hadoop、spark |

| spark-slave02 | 192.168.252.123 | jdk、hadoop、spark |

依赖环境

Spark 是在 Scala 语言中实现的,它将 Scala 用作其应用程序框架。与 Hadoop 不同,Spark 和 Scala 能够紧密集成,其中的 Scala 可以像操作本地集合对象一样轻松地操作分布式数据集。所有我们安装 Scala

Scala

Hadoop

安装

下载解压

1 | su hadoop |

环境变量

如果是对所有的用户都生效就修改vi /etc/profile 文件

如果只针对当前用户生效就修改 vi ~/.bahsrc 文件

1 | sudo vi /etc/profile |

1 | #spark |

使环境变量生效,运行 source /etc/profile使/etc/profile文件生效

修改配置

修改 spark-env.sh

1 | cd /home/hadoop/spark-2.2.0/conf |

1 | mv spark-env.sh.template spark-env.sh |

1 | #java |

简单介绍几个变量

- JAVA_HOME:Java安装目录

- SCALA_HOME:Scala安装目录

- HADOOP_HOME:hadoop安装目录

- HADOOP_CONF_DIR:hadoop集群的配置文件的目录

- SPARK_MASTER_IP:spark集群的Master节点的ip地址

- SPARK_WORKER_MEMORY:每个worker节点能够最大分配给exectors的内存大小

- SPARK_WORKER_CORES:每个worker节点所占有的CPU核数目

- SPARK_WORKER_INSTANCES:每台机器上开启的worker节点的数目

修改 slaves

1 | cd /home/hadoop/spark-2.2.0/conf |

1 | mv slaves.template slaves |

1 | node1 |

配置集群

复制节点

进去 spark 安装目录 ,打包,并发送,到其他节点

1 | cd cd /home/hadoop/ |

进去 node1,node2 节点 解压

1 | cd /home/hadoop/ |

环境变量

到这里一步 确保你的每一个节点 环境变量够数

1 | #jdk |

启动集群

关闭防火墙

1 | systemctl stop firewalld.service |

启动 Hadoop

1 | cd /home/hadoop/hadoop-2.7.4/sbin |

启动 Spark

1 | cd /home/hadoop/spark-2.2.0/sbin |

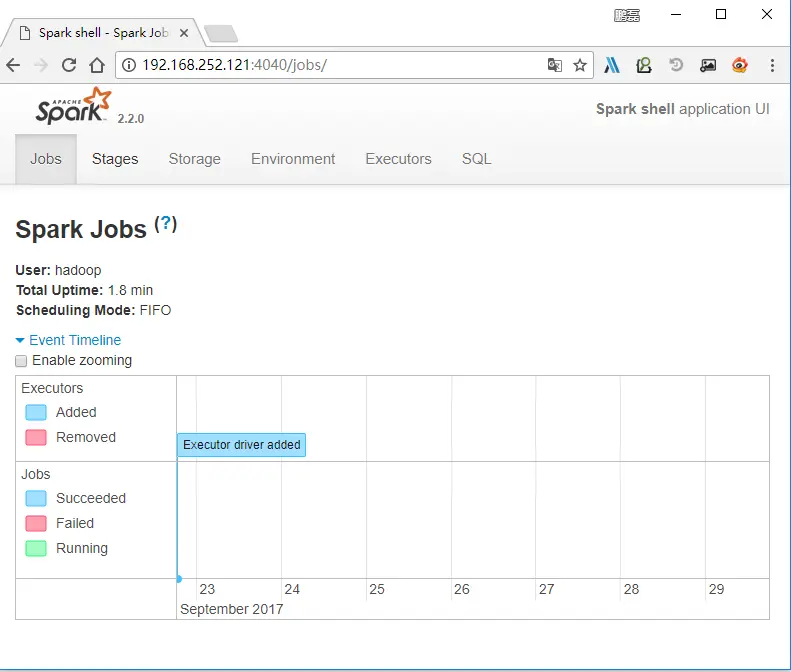

启动 Spark Shell

1 | cd /home/hadoop/spark-2.2.0/bin |

spark 访问:192.168.252.121:8080

spark-shell 访问:192.168.252.121:4040